Deep Learning verändert die Fahrzeugschadensbewertung grundlegend. Systeme analysieren Fotos, erkennen Schäden wie Kratzer oder Dellen und liefern präzise Ergebnisse – oft in weniger als 90 Sekunden. Mit neuronalen Netzwerken, die Millionen von Bildern trainieren, wird die Schadensanalyse schneller, genauer und standardisiert. Sensoren ergänzen diese Ansätze, indem sie versteckte Schäden aufdecken.

Kernpunkte:

- Automatische Schadensanalyse: Fotos hochladen, Schäden werden pixelgenau erkannt.

- Zeitersparnis: Bewertung in Sekunden statt Stunden.

- Kostenschätzung: KI nutzt Werkstattdaten und historische Fälle.

- Kombination von Bild- und Sensordaten: Für umfassendere Ergebnisse.

Ob Leasingrückgabe, Versicherungsansprüche oder Flottenmanagement – diese Technologien optimieren Prozesse und reduzieren Fehler. Einschränkungen wie Bildqualität und Modellvielfalt bleiben Herausforderungen, zeigen aber das Potenzial für Weiterentwicklungen.

Wie Deep Learning Fahrzeugschäden erkennt

Training neuronaler Netzwerke mit Schadensbildern

Die Basis der Schadenserkennung bildet Convolutional Neural Networks (CNNs). Diese spezialisierten Deep-Learning-Modelle analysieren Fotos und erkennen Muster wie Form, Farbe und Textur. Um diese Fähigkeit zu entwickeln, benötigen sie ein umfangreiches Training mit Tausenden bis Millionen gelabelten Schadensbildern. So lernen sie, zwischen Dellen, Kratzern, Rissen und anderen Schäden zu unterscheiden.

Dabei spielt die Vielfalt der Trainingsdaten eine zentrale Rolle. Die Bilder müssen verschiedene Fahrzeugmodelle, Lackfarben, Lichtverhältnisse und Perspektiven abdecken, um die Genauigkeit in der Praxis sicherzustellen. Zunächst identifizieren die Modelle die Fahrzeugkomponenten, bevor sie die Schadensart und -schwere klassifizieren. Regelmäßige Updates der Daten sorgen dafür, dass die KI auch bei neuen Fahrzeugdesigns und Materialien präzise bleibt. Dank Bildsegmentierung kann das System Schäden exakt lokalisieren.

Bildsegmentierung und Schadenslokalisierung

Mit Instance Segmentation wird nicht nur festgestellt, dass ein Schaden vorhanden ist, sondern auch dessen exakte Kontur pixelgenau erfasst. Object-Detection-Algorithmen analysieren die visuellen Daten, lokalisieren Schäden und kategorisieren sie nach Art und Schwere. Diese pixelgenaue Analyse hilft, tatsächliche Schäden von optischen Täuschungen wie Reflexionen oder Verschmutzungen zu unterscheiden.

Für optimale Ergebnisse sollten die Bilder aus 1–2 Metern Entfernung und bei weichem Licht aufgenommen werden – idealerweise morgens, abends oder bei bewölktem Himmel. Harte Schatten oder starke Reflexionen können die KI verwirren und zu Fehleinschätzungen führen.

Analyse des Schadensausmaßes

Nach der Lokalisierung vergleicht die KI den Schaden mit historischen Daten und Informationen der Fahrzeughersteller (OEM), um den Schweregrad genau zu bestimmen. Sie unterscheidet dabei zwischen oberflächlichen Schäden wie Kratzern und tiefergehenden strukturellen Problemen, die die Sicherheit des Fahrzeugs beeinträchtigen könnten. Mithilfe millimetergenauer Messungen und vordefinierter Schwellenwerte entscheidet das System, ob eine Reparatur ausreicht oder ein Austausch erforderlich ist.

Fortschrittliche Modelle erkennen sogar verdeckte Schäden, die auf Bildern nicht direkt sichtbar sind, wie etwa Verformungen hinter einem Stoßfänger. In der Praxis werden die Ergebnisse der KI-gestützten Schadenerkennung oft von menschlichen Experten geprüft, insbesondere bei komplexen Fällen, um rechtlich einwandfreie Gutachten zu gewährleisten. Solche Prüfungen sind besonders wichtig, wenn es um die Abwägung zwischen Reparatur und Austausch geht.

Kostenschätzung und Reparaturprognose

Nutzung von Werkstattdaten und NLP für Kostenvorhersagen

Die KI kombiniert visuelle Schadensdaten mit umfangreichen Werkstattdatenbanken, um realistische Kostenschätzungen zu liefern. Dabei kommen Technologien wie Natural Language Processing (NLP) und große Sprachmodelle, darunter ChatGPT, zum Einsatz. Diese Systeme gleichen strukturierte Schadensdaten mit historischen Gutachten ab, lernen aus Tausenden von Reparaturberichten und identifizieren Muster zwischen Schadensarten, Fahrzeugmodellen und den tatsächlichen Werkstattkosten. Das Ergebnis: technische Daten werden in präzise und rechtssichere Gutachtentexte übersetzt, die als Grundlage für tiefergehende Analysen dienen.

Statistische Modelle zur Kostenberechnung

Mit diesen Daten werden statistische Modelle entwickelt, die präzise Reparaturkosten berechnen. Moderne KI-Systeme nutzen multimodale Datenquellen: Fotos und Videos liefern visuelle Hinweise, Werkstattberichte bieten Erfahrungswerte, und strukturierte Preiskataloge stellen aktuelle Marktdaten bereit. Durch den Abgleich mit ähnlichen Schadensfällen erstellt die KI treffsichere Kostenvorhersagen. Einige fortschrittliche Systeme erreichen dabei eine Trefferquote von über 95 % bei der Schadenserkennung, senken Inspektionszeiten um bis zu 80 % und basieren auf Datensätzen mit über 10 Millionen annotierten Bildern.

Verknüpfung visueller Schäden mit Kostenmodellen

Die wahre Stärke liegt in der Kombination aus visuellen Daten und kostenbasierten Modellen – ein entscheidender Schritt im Prognoseprozess. Die KI analysiert nicht nur die Schadensart, sondern auch deren genaue Position am Fahrzeug. Denn die Reparaturkosten können je nach Stelle erheblich variieren.

"A system trained on millions of images recognizes that a 3mm dent on a door seam costs 4× more to repair than the same dent on a quarter panel." - Self Inspection

Zusätzlich berücksichtigt die KI regionale Unterschiede bei Arbeits- und Ersatzteilkosten, um standortspezifische Schätzungen zu ermöglichen. Ein Beispiel: Eine Delle an der Türnaht erfordert oft den Austausch des gesamten Bauteils, während dieselbe Delle an der Seitenwand meist ausgebeult werden kann. Solche Details erkennt die KI automatisch und liefert so differenzierte Ergebnisse.

Stärken und Grenzen bildbasierter KI

Vorteile bildbasierter Systeme

Bildbasierte KI-Systeme können innerhalb von nur 30 Sekunden präzise Schadensberichte erstellen und dabei Inspektionszeiten um bis zu 80 % senken. Ein Beispiel: Im Projekt von TÜV Rheinland und Merantix wurde die Inspektionszeit sogar um 94 % reduziert, während die Schadenserkennung um 17 % bis 40 % verbessert wurde [magazin.cubee.expert].

Ein weiterer Vorteil ist die ständige Weiterentwicklung dieser Systeme. Mit Datensätzen von mehr als 10 Millionen annotierten Bildern erreichen moderne Modelle Genauigkeitsraten von über 95 %. Damit kommen sie der Expertise menschlicher Gutachter sehr nahe. Sie sind außerdem in der Lage, materialspezifische Unterschiede zu erkennen. So wird beispielsweise ein Kratzer auf Aluminium anders bewertet und repariert als ein identischer Kratzer auf Carbon oder Stahl.

Herausforderungen und Einschränkungen

Trotz der beeindruckenden Fortschritte gibt es technische Hürden. Ein großes Problem ist die Abhängigkeit von der Bildqualität. Standardmodelle wie YOLO oder Mask R-CNN setzen oft auf Geschwindigkeit, was die detaillierte Analyse von Schäden wie Haarrissen oder flachen Dellen erschwert.

Ein weiteres Hindernis ist die Generalisierungsfähigkeit. Modelle, die auf allgemeinen Datensätzen trainiert wurden, haben Schwierigkeiten, die spezifischen Konturen verschiedener Fahrzeugmodelle zu erkennen. Ebenso fällt es ihnen manchmal schwer, Materialien wie Carbon und Aluminium zuverlässig zu unterscheiden.

Diese Einschränkungen wirken sich besonders bei komplexen Schadensfällen aus, die eine präzise Materialanalyse erfordern. Dennoch zeigen die bisherigen Ergebnisse, dass diese Systeme in der Praxis durchaus überzeugen können.

Leistungskennzahlen und Genauigkeitsraten

Zwischen Oktober und Dezember 2021 führte die Allianz Deutschland KI-gestützte Prüfungen bei etwa 30.000 Schadensfällen durch. Dabei wurde stets auf die Kombination aus KI und menschlicher Expertise gesetzt, um Transparenz und Zuverlässigkeit sicherzustellen [magazin.cubee.expert].

Fortschrittliche Systeme setzen mittlerweile auf Techniken wie Slicing Aided Hyper Inference (SAHI). Diese Methode teilt hochauflösende Bilder in überlappende Abschnitte, sodass selbst mikroskopisch kleine Schäden wie 2‑mm‑Lackabplatzer erfasst werden können. Der Trend geht dabei klar in Richtung spezialisierter Trainingsmethoden, die sowohl die Fahrzeuggeometrie als auch materialspezifische Lernansätze stärker berücksichtigen.

Sensorbasierte vs. Bildbasierte Erkennungssysteme

Vergleich: Sensorbasierte vs. Bildbasierte KI-Schadenserkennung

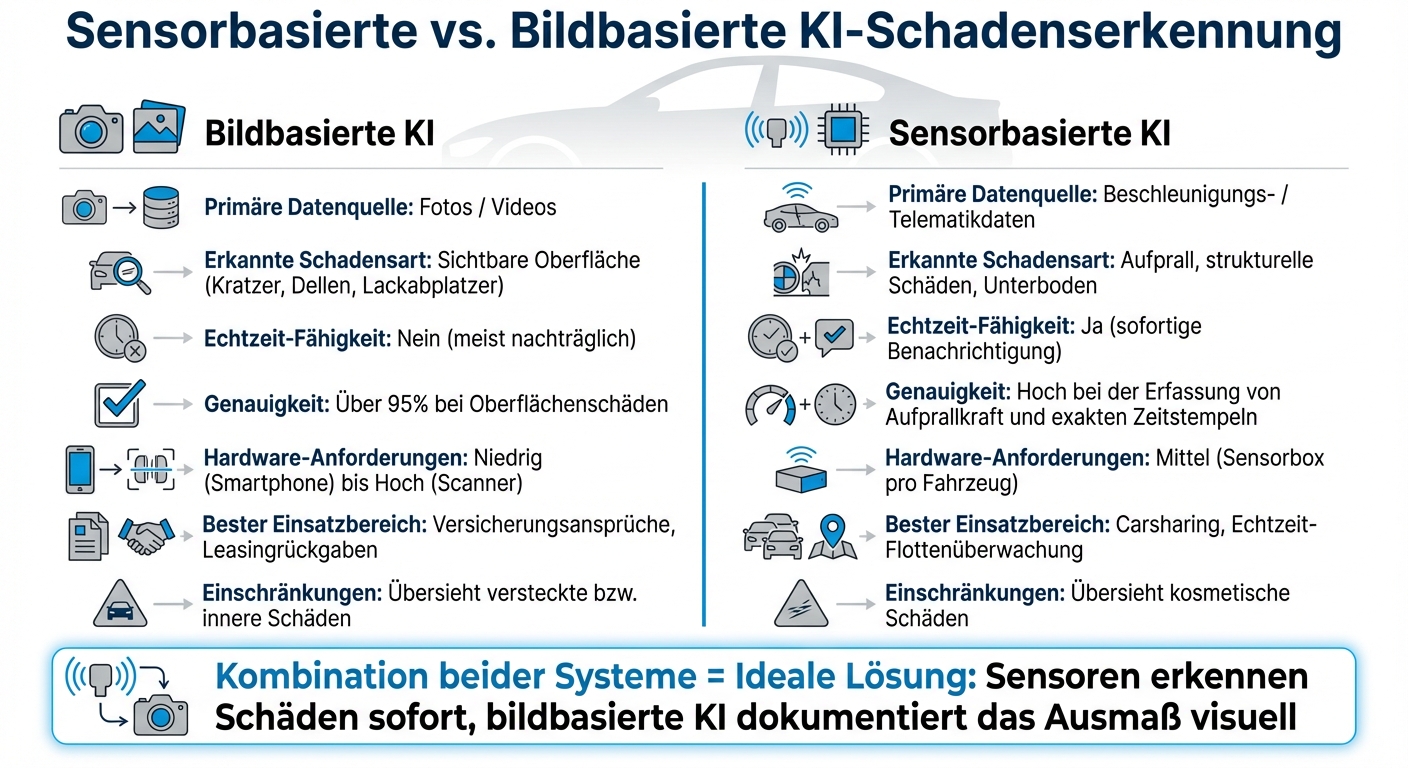

Nach der Betrachtung bildbasierter Ansätze folgt hier ein Vergleich mit sensorbasierten Verfahren, um die Unterschiede und jeweiligen Stärken zu verdeutlichen.

Wichtige Unterschiede zwischen beiden Ansätzen

Bildbasierte Systeme setzen auf Convolutional Neural Networks (CNNs), um visuelle Daten wie Fotos oder Videos zu analysieren. Damit erkennen sie vor allem sichtbare Schäden wie Kratzer, Dellen oder Lackabplatzer. Im Gegensatz dazu arbeiten sensorbasierte Systeme mit Sensorboxen, die im Fahrzeug installiert sind. Diese erfassen kontinuierlich Beschleunigungs- und Vibrationsdaten in Echtzeit und können so auch strukturelle Schäden, Unterbodenprobleme oder interne Defekte erkennen, die für Kameras unsichtbar bleiben.

Ein weiterer Unterschied liegt im Zeitpunkt der Datenerfassung. Während bildbasierte Systeme oft nur zu bestimmten Zeitpunkten – etwa bei der Fahrzeugrückgabe – genutzt werden, überwachen Sensoren das Fahrzeug kontinuierlich. Sie zeichnen präzise den Zeitpunkt und Ort eines Vorfalls auf, was besonders für Carsharing-Anbieter bei der Klärung von Haftungsfragen entscheidend ist.

Vorteile sensorbasierter Systeme

Sensorbasierte Systeme arbeiten unabhängig von äußeren Bedingungen. Bildbasierte Lösungen benötigen gute Lichtverhältnisse, klare Sicht und hochwertige Kameratechnik, wohingegen Sensoren bei jedem Wetter und zu jeder Tageszeit zuverlässig funktionieren. Zusätzlich liefern Sensoren Informationen über den Fahrzeugzustand, was eine frühzeitige Erkennung von Verschleiß oder sicherheitskritischen Problemen ermöglicht – oft, bevor ein sichtbarer Schaden entsteht.

Interessant ist auch, dass manuelle Sichtprüfungen bis zu 90 % der Schäden übersehen können, insbesondere am Unterboden. Sensoren schließen diese Lücke und bieten Flottenmanagern sowie Carsharing-Anbietern eine bessere Grundlage für Wartungsplanung und Sicherheit.

Vergleichstabelle: Sensor vs. Bildbasiert

| Merkmal | Bildbasierte KI | Sensorbasierte KI |

|---|---|---|

| Primäre Datenquelle | Fotos / Videos | Beschleunigungs- / Telematikdaten |

| Erkannte Schadensart | Sichtbare Oberfläche (Kratzer, Dellen, Lackabplatzer) | Aufprall, strukturelle Schäden, Unterboden |

| Echtzeit-Fähigkeit | Nein (meist nachträglich) | Ja (sofortige Benachrichtigung) |

| Genauigkeit | Über 95 % bei Oberflächenschäden | Hoch bei der Erfassung von Aufprallkraft und exakten Zeitstempeln |

| Hardware-Anforderungen | Niedrig (Smartphone) bis Hoch (Scanner) | Mittel (Sensorbox pro Fahrzeug) |

| Bester Einsatzbereich | Versicherungsansprüche, Leasingrückgaben | Carsharing, Echtzeit-Flottenüberwachung |

| Einschränkungen | Übersieht versteckte bzw. innere Schäden | Übersieht kosmetische Schäden |

Die Kombination beider Systeme bietet eine ideale Lösung: Sensoren erkennen Schäden sofort und alarmieren, während die bildbasierte KI das Ausmaß visuell dokumentiert. Diese Kombination wird immer beliebter, da sie die Stärken beider Ansätze vereint und eine umfassendere Schadensanalyse ermöglicht.

Fazit und zukünftige Entwicklungen

Wichtigste Erkenntnisse

Die bisherige Analyse zeigt, wie moderne Deep-Learning-Technologien die KFZ-Schadensbewertung grundlegend verändern. Bildbasierte KI-Systeme können Oberflächenschäden wie Kratzer und Dellen mit einer Präzision von über 95 % erkennen. Dabei identifizieren sie mehr als 127 Fahrzeugmarken und über 1.200 Modelle, was die Inspektionszeiten erheblich verkürzt. Zusätzlich ermöglichen sensorbasierte Systeme die Echtzeitüberwachung struktureller Schäden, die mit Kameras oft nicht sichtbar sind. Diese Technologien reduzieren typische Fehler, die bei manuellen Prüfungen auftreten, und liefern somit präzisere Schadensbewertungen sowie transparentere Kostenkalkulationen. Die Kombination dieser Ansätze schafft eine solide Grundlage für künftige Innovationen in der KI-gestützten Schadensanalyse.

Zukunftstrends in der KI-Schadensbewertung

Mit der Weiterentwicklung der KI-Technologien entstehen neue Ansätze, die die bisherigen Möglichkeiten erweitern. Generative Adversarial Networks (GANs) sind ein Beispiel: Sie erzeugen synthetische Trainingsdaten für seltene Schadensarten wie Hagelschäden oder Korrosion durch Hochwasser. Dies gleicht Datenungleichgewichte aus und verbessert die Fähigkeit der KI, auch seltene, aber kritische Schäden zuverlässig zu erkennen. Darüber hinaus ermöglicht die 3D-Bildanalyse die frühzeitige Erkennung von Materialermüdung und Klarlackschäden.

Eine weitere Innovation ist die Slicing Aided Hyper Inference (SAHI)-Technologie. Sie teilt hochauflösende Bilder in überlappende Segmente und kann so mikroskopische Schäden von nur 2 mm Größe in weniger als 30 Sekunden lokalisieren.

"Deep Learning has fundamentally shifted the automotive inspection paradigm from reactive damage discovery to predictive claim management." – Self Inspection

Explainable AI (XAI) sorgt dafür, dass KI-Entscheidungen transparent und nachvollziehbar sind, was regulatorische Anforderungen erfüllt. Künftige Systeme werden zudem Multi-Architektur-Ensembles nutzen, um die Stärken verschiedener Modelle in Bezug auf Geschwindigkeit und Präzision zu kombinieren. Dieser Ansatz verspricht eine noch höhere Genauigkeit der Schadensbewertung.

Diese technologischen Fortschritte verbessern den gesamten Bewertungsprozess erheblich. Unternehmen wie die CUBEE Sachverständigen AG integrieren diese Entwicklungen bereits in ihre Arbeit, um schnelle, präzise und transparente KFZ-Gutachten zu erstellen.

FAQs

Wie sicher erkennt KI echte Schäden statt Reflexionen oder Schmutz?

KI bewertet Fahrzeugschäden äußerst präzise, indem sie Kratzer, Dellen und andere Beschädigungen innerhalb von Sekunden erkennt. Dabei kann sie effektiv zwischen tatsächlichen Schäden, Reflexionen und Verschmutzungen unterscheiden. Dennoch bleibt bei komplexeren Fällen die Expertise menschlicher Gutachter unerlässlich, um eine umfassende und exakte Einschätzung sicherzustellen.

Was passiert, wenn die Fotos zu dunkel oder unscharf sind?

Sind die Fotos zu dunkel oder unscharf, kann es passieren, dass die KI Schäden nicht richtig erkennt oder falsch einordnet. Das wirkt sich direkt auf die Genauigkeit der Schadensbewertung aus. Deshalb ist es wichtig, gut beleuchtete und scharfe Bilder zu machen, um optimale Ergebnisse zu gewährleisten.

Wie helfen GANs bei seltenen Schäden wie Hagel oder Hochwasser?

Generative Adversarial Networks (GANs) spielen eine wichtige Rolle bei der Analyse seltener Schadensereignisse wie Hagel oder Hochwasser. Sie erstellen realistische Schadensbilder, die dabei helfen, solche Szenarien besser zu erkennen und zu klassifizieren. Dadurch wird die Präzision von KI-Modellen in diesen spezifischen Fällen deutlich verbessert.

Verwandte Blogbeiträge

- Wie KI und Computer Vision Fahrzeugschäden erkennen

- So funktioniert KI-gestützte Schadensbewertung

- Wie präzise ist KI bei der Schadensbewertung?

- Wie Deep Learning Modelle Schäden am Fahrzeug erkennen