Mask R-CNN revolutioniert die KFZ-Schadensbewertung. Die Technologie ermöglicht pixelgenaue Segmentierung von Schäden wie Kratzern, Dellen oder Glasbruch direkt aus Fotos. Das spart Zeit, steigert die Genauigkeit und automatisiert Prozesse für Versicherungen und Gutachter.

Wesentliche Vorteile:

- Präzision: Schäden werden bis auf Pixelebene analysiert.

- Effizienz: Automatisierte Kostenschätzungen aus hochgeladenen Fotos.

- Kompakte Datensätze: Funktionierende Modelle können mit nur 66 Bildern trainiert werden.

- Anwendungsgebiete: KI vs. Mensch in der Schadensbewertung, Versicherungsprozesse, Fahrzeugbegutachtung.

Technische Details:

- Kombination aus Faster R-CNN und Fully Convolutional Network (FCN).

- Verbesserte Genauigkeit durch RoIAlign und Transfer Learning.

- Durchschnittliche Präzision (AP) von bis zu 0,83 in Tests mit KFZ-Schadensdaten.

Die Technologie wird bereits erfolgreich in Fallstudien wie der CUBEE Sachverständigen AG eingesetzt und zeigt Potenzial für weitere Anwendungen wie autonome Fahrzeuge. Mask R-CNN ist ein Schritt in Richtung automatisierter, präziser und schneller Schadensbewertung.

Fallstudie 1: Automatische Erkennung von äußeren Schäden

Im Januar 2020 veröffentlichten Forscher in der Fachzeitschrift IEEE Access eine Studie, in der ein optimiertes Mask R-CNN-Modell vorgestellt wurde. Das Projekt setzte einen Datensatz mit 2.000 Bildern von Fahrzeugschäden ein – 1.600 Bilder wurden für das Training genutzt, 400 für Tests. Durch die Optimierung von ResNet50 und Anpassung der Anchor-Skalen erreichte das Modell eine durchschnittliche Präzision (AP) von 0,83 und eine Erkennungsgeschwindigkeit von 3,52 fps. Ziel des Systems war es, die Schadensregulierung nach Verkehrsunfällen zu verbessern, indem beschädigte Bereiche unter verschiedenen Lichtbedingungen präzise segmentiert werden konnten.

Ein weiteres Beispiel zeigt den praktischen Nutzen dieser Technologie. Im August 2021 entwickelte Eashan Kaushik einen dreistufigen Trainingsprozess. Dieser umfasste zunächst allgemeine Bounding Boxes, dann die Klassifizierung von vier Schadenstypen (Kratzer, Dellen, Glasbruch, Verschiebung) und abschließend die präzise Polygon-Annotation für die Instanzsegmentierung. Das System wurde über ein Flask-Framework bereitgestellt und berechnete vorläufige Reparaturkosten basierend auf dem Verhältnis der Schadensmaske zur Bildgröße.

Vorteile für die Schadensbewertung

Die beschriebenen Ansätze bieten neben hoher Erkennungsgenauigkeit auch praktische Vorteile. Besonders in der KFZ-Schadensregulierung lösen sie zentrale Herausforderungen. Im Gegensatz zu herkömmlichen Erkennungsmodellen kann Mask R-CNN die genaue Form eines Schadens identifizieren. Dadurch werden präzisere Kostenschätzungen ermöglicht, da das Verhältnis zwischen Schadensmaske und Gesamtbildgröße berechnet wird.

Für Versicherungsunternehmen bedeutet dies eine effizientere Schadensabwicklung. Kunden können Fotos hochladen und sofort eine automatisierte Bewertung erhalten. Louis Lim, ein Entwickler, erläutert die Motivation hinter diesem Ansatz:

„The rationale for such a model is that it can be used by insurance companies for faster processing of claims if users can upload pics and they can assess damage from them".

Technische Details der Implementierung

Das verbesserte Mask R-CNN-Modell konnte die Erkennungsgenauigkeit um 2,15 % und die Maskierungsgenauigkeit um 1,89 % steigern, während die Geschwindigkeit um 0,52 fps erhöht wurde. Die Architektur basiert auf ResNet50 mit FPN für die Extraktion von Multi-Skalen-Merkmalen und verwendet RoIAlign mit bilinearer Interpolation anstelle von RoIPooling, um räumliche Details zu bewahren.

Transfer Learning ist ein zentraler Bestandteil: Modelle werden zunächst auf großen Datensätzen wie MS COCO vortrainiert und anschließend auf spezifische Fahrzeugschadensdaten angepasst. Selbst mit kleinen Datensätzen – etwa 68 Bildern (50 Training, 16 Validierung, 2 Test) – lassen sich funktionierende Systeme entwickeln. Für präzisere Ergebnisse empfiehlt es sich, Polygon-Annotationen anstelle einfacher Bounding Boxes zu verwenden.

sbb-itb-d35113a

Fallstudie 2: Präzise Analyse von Versicherungsfotos

Nach der detaillierten Betrachtung der automatisierten Erkennung äußerer Schäden in der ersten Fallstudie wird hier gezeigt, wie Versicherungsfotos präzise ausgewertet werden können.

Versicherungsunternehmen stehen oft vor der Frage: Wie kann man aus einem einfachen Kundenfoto die tatsächliche Schadenshöhe bestimmen? Mask R-CNN bietet eine Lösung durch pixelgenaue Segmentierung, die den Prozess der digitalen Schadensbewertung effizienter macht. Im Gegensatz zu traditionellen Modellen liefert Mask R-CNN nicht nur Bounding Boxes, sondern auch exakte Schadensmasken. Dies wird durch einen zusätzlichen Zweig erreicht, der eine binäre Maske ausgibt und so die genauen Pixel des Schadens identifiziert.

Die Architektur kombiniert Faster R-CNN für die Objekterkennung mit einem Fully Convolutional Network (FCN), das für die pixelgenaue Grenzflächenerkennung sorgt. Dadurch können selbst unregelmäßige Schadensformen präzise erfasst werden. Priya Dwivedi, Präsidentin von Deep Learning Analytical Solutions, hebt die praktische Anwendbarkeit hervor:

„The rationale for such a model is that it can be used by insurance companies for faster processing of claims if users can upload pics and they can assess damage from them."

Skalierung von Schäden mithilfe von Referenzobjekten

Die Schadensbewertung erfordert nicht nur eine präzise Erkennung, sondern auch eine genaue Quantifizierung der Schadensausdehnung. Hierbei wird das Verhältnis der Schadensmaske zur Gesamtgröße des Fotos genutzt, um die Ausdehnung des Schadens genauer zu berechnen.

Das System unterscheidet mindestens vier Schadenskategorien: Kratzer, Dellen, Verschiebungen und Glasbruch. Jede Kategorie erfordert dabei eine spezifische Bewertungsmethode. Kratzer werden beispielsweise anhand ihrer Länge und Pixeldichte gemessen, während Dellen eine flächenbasierte Analyse benötigen. Mit der Kombination aus Transfer Learning und Ensemble-Learning-Techniken erzielten Forscher eine Klassifizierungsgenauigkeit von 89,5 % bei Fahrzeugschäden.

Diese präzise Quantifizierung verbessert nicht nur die Schadensermittlung, sondern optimiert den gesamten Versicherungsprozess.

Auswirkungen auf Versicherungsprozesse

Die automatisierte Analyse beschleunigt die Schadensregulierung erheblich. Kunden können ihre Fotos direkt hochladen und erhalten eine KI-basierte Bewertung, ohne auf manuelle Inspektionen warten zu müssen. Dank der Instanzsegmentierung können selbst mehrere Schäden, auch wenn sie vom gleichen Typ sind, voneinander unterschieden werden.

Die pixelgenaue Lokalisierung liefert zudem messbare Daten zur Schadensschwere. Das erleichtert Entscheidungen darüber, ob ein Bauteil repariert oder ausgetauscht werden sollte, und macht diese objektiver.

Fallstudie 3: Digitale Gutachten bei CUBEE Sachverständigen AG

Die CUBEE Sachverständigen AG zeigt eindrucksvoll, wie Mask R-CNN in der Fahrzeugbegutachtung eingesetzt werden kann. Diese KI-Technologie wird sowohl an den Container-Standorten des Unternehmens in Deutschland und Europa als auch bei mobilen Begutachtungen direkt am Unfallfahrzeug verwendet. Dabei ermöglicht die automatisierte Segmentierung eine präzise Erkennung der relevanten Schadensmerkmale.

Ein zentraler Vorteil ist die KI-gestützte Plausibilitätsprüfung, die erkannte Schäden automatisch mit den vorhandenen Gutachterdaten abgleicht. Dadurch wird der Bewertungsprozess erheblich beschleunigt – eine Effizienzsteigerung, die sich bereits in anderen Fallstudien als entscheidend erwiesen hat. Schadensdaten werden direkt vor Ort erfasst und in Echtzeit verarbeitet, was die Grundlage für weitere Verbesserungen in den Abläufen schafft.

Optimierung der Begutachtungsabläufe

Die pixelgenaue Schadenserkennung durch Mask R-CNN reduziert die Zeit für manuelle Inspektionen erheblich. Das System übernimmt die automatisierte Segmentierung und Lokalisierung der Schäden, sodass sich der Sachverständige stärker auf die fachliche Bewertung und Dokumentation konzentrieren kann.

Vorteile für Kunden

Für Kunden bedeutet dieser digitalisierte Prozess schnellere und objektivere Gutachten. Die automatisierte Schadenserkennung sorgt für eine transparente und nachvollziehbare Bewertung. Wie bereits in ähnlichen Beispielen gezeigt, führt dies zu durchgehend präzisen Ergebnissen. Kunden können wählen, ob sie ihr Fahrzeug an einem der Container-Standorte begutachten lassen oder den mobilen Service nutzen möchten, bei dem der Gutachter direkt zum Fahrzeug kommt – beide Optionen basieren auf der gleichen zuverlässigen KI-Technologie.

Fallstudie 4: Schadenserkennung in komplexen Umgebungen

Unfallorte, Werkstätten oder enge Garagen stellen anspruchsvolle Bedingungen für die KI-gestützte Schadensbewertung dar. Mask R-CNN muss in solchen Szenarien zwischen tatsächlichen Fahrzeugschäden und Ablenkungen wie Werkzeugen oder anderen Fahrzeugen unterscheiden. Dank der Instanzsegmentierung ist das Modell in der Lage, jeden Schaden pixelgenau zu identifizieren, selbst wenn mehrere Fahrzeuge im Bild vorhanden sind.

Die Architektur kombiniert ein Region Proposal Network (RPN), das potenzielle Schadensbereiche identifiziert, mit einem Mask-Zweig, der die genaue Klassifizierung jedes Pixels übernimmt. Komplexe Lichtverhältnisse stellen dabei eine besondere Herausforderung dar, da geringe Gradientenunterschiede das Training erschweren und intensivere Anpassungen erfordern. Um diese Hürden zu meistern, sind spezielle Anpassungen der Instanzsegmentierung notwendig, die im Folgenden näher erläutert werden.

Anpassung der Instanzsegmentierung für schwierige Szenarien

In unübersichtlichen Umgebungen erweisen sich Transfer Learning und präzise Annotationsmethoden als Schlüssel zum Erfolg. Polygonbasierte Annotationen liefern dem Modell detailliertere räumliche Informationen, was die Genauigkeit der Ergebnisse deutlich steigert. Die Feinabstimmung vortrainierter Modelle auf spezifische Schadensmuster hilft, auch bei visuellen Störfaktoren zuverlässige Ergebnisse zu erzielen.

Diese Fortschritte in der Segmentierung eröffnen nicht nur neue Möglichkeiten für die Schadenserkennung, sondern auch für andere Anwendungsbereiche.

Potenzielle Anwendungen für die Zukunft

Die Fähigkeit von Mask R-CNN, Schäden selbst in komplexen Szenarien zu erkennen, birgt enormes Potenzial. Priya Dwivedi, President von Deep Learning Analytical Solutions, hebt hervor:

„Self-Driving Cars need to know the exact pixel location of the road; potentially of other cars as well to avoid collisions".

Diese Technologie könnte zukünftig nicht nur in der Schadenserkennung für autonome Fahrzeuge, sondern auch bei automatisierten Straßeninspektionen ohne menschliche Gutachter eingesetzt werden. Mit Open-Source-Frameworks wie Detectron2 wird die Integration in kommerzielle Anwendungen der Automobilbranche zusätzlich erleichtert.

Technisches Framework und Leistungsvergleich

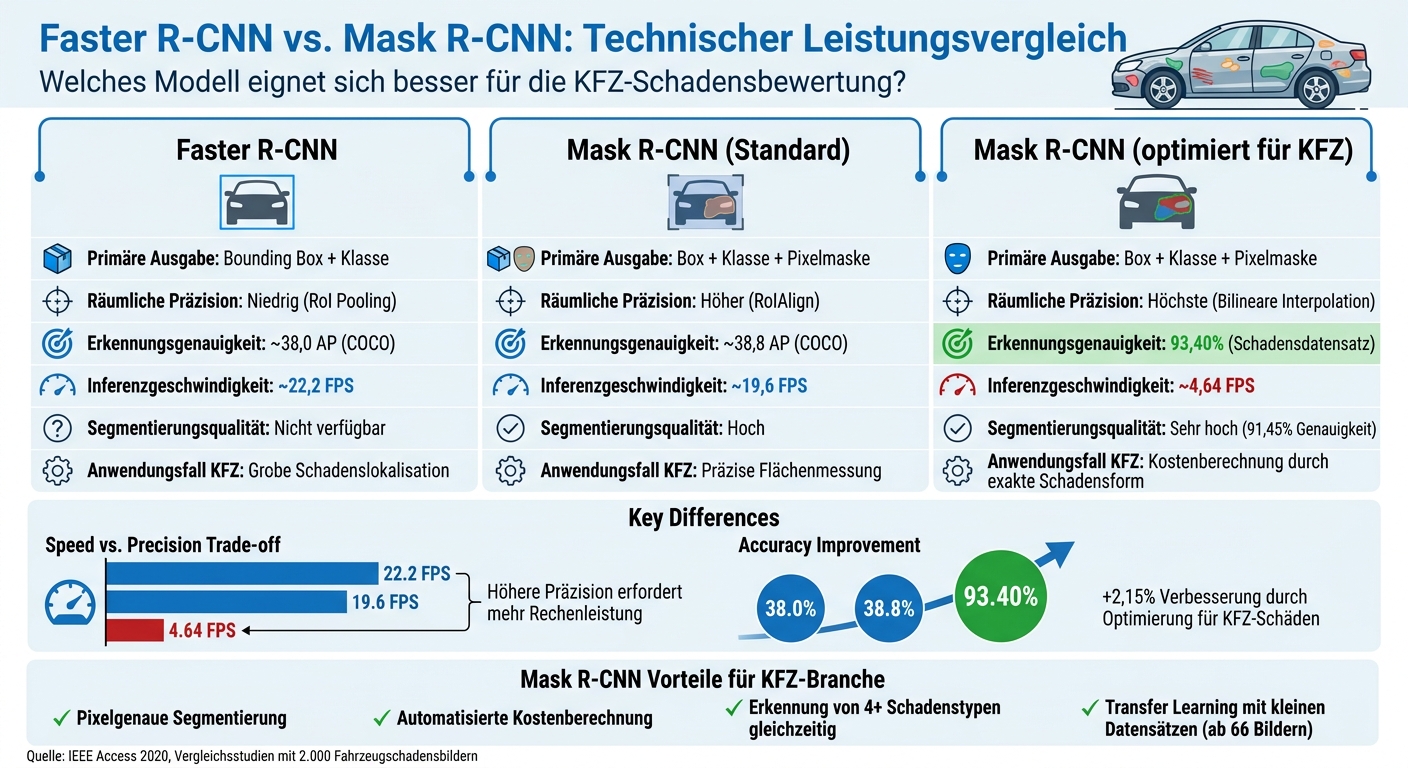

Mask R-CNN vs Faster R-CNN: Leistungsvergleich für KFZ-Schadenserkennung

Hier wird das technische Framework von Mask R-CNN detailliert beschrieben und dessen Leistung im Vergleich zu Faster R-CNN analysiert.

Mask R-CNN baut auf dem bekannten Faster R-CNN auf, ergänzt jedoch einen FCN-Zweig (Fully Convolutional Network), der pixelgenaue Segmentierungsmasken erstellt. Während Faster R-CNN lediglich Bounding Boxes und Klassenlabels liefert, ermöglicht Mask R-CNN eine präzise Bestimmung von Form und Größe eines Schadens – eine wichtige Funktion, insbesondere für die exakte Kostenberechnung in der Schadensbewertung. Das Region Proposal Network (RPN) durchsucht zunächst die Feature Maps eines Backbones wie ResNet-50 oder ResNet-101, um potenzielle Schadensbereiche zu identifizieren. Anschließend verfeinert die Bounding Box Regression die Positionen, während der FCN-Zweig für jede Region eine binäre Maske generiert.

Ein entscheidender Fortschritt ist der Einsatz von RoIAlign anstelle von RoI Pooling. Durch bilineare Interpolation bleiben die räumlichen Positionen exakt erhalten. Wie in Fallstudie 1 beschrieben, spielt die Multi-Task-Loss-Funktion eine zentrale Rolle bei der Verbesserung der Präzision.

Diese technischen Verbesserungen spiegeln sich direkt in den Leistungskennzahlen wider.

Leistungsmetriken und Genauigkeit

Im Januar 2020 veröffentlichten die Forscher Qinghui Zhang, Xianing Chang und Shanfeng Bian eine Studie im IEEE Access, in der sie 2.000 Bilder beschädigter Fahrzeuge (1.600 für das Training, 400 für Tests) annotierten. Mit angepassten Loss-Funktionen für verschiedene Zielgrößen erreichten sie einen Average Precision (AP) von 0,83 – eine Verbesserung der Erkennungsgenauigkeit um 2,15 % im Vergleich zum Standard-Mask-R-CNN. Die Genauigkeit der Masken betrug beeindruckende 91,45 %.

Die Inferenzgeschwindigkeit zeigt jedoch Unterschiede: Während Faster R-CNN auf vergleichbarer Hardware etwa 22,2 FPS erreicht, liegt Mask R-CNN bei 19,6 FPS. Der zusätzliche FCN-Zweig erfordert mehr Rechenleistung, liefert jedoch die für präzise Schadensgutachten erforderliche pixelgenaue Segmentierung. Dies unterstreicht die Zukunft der KI-Schadensbewertung in der Automobilindustrie.

Die folgende Tabelle fasst die Unterschiede zwischen Faster R-CNN und verschiedenen Mask R-CNN-Konfigurationen zusammen.

Vergleichstabelle der Modelle

| Metrik | Faster R-CNN | Mask R-CNN (Standard) | Mask R-CNN (optimiert für KFZ) |

|---|---|---|---|

| Primäre Ausgabe | Bounding Box + Klasse | Box + Klasse + Pixelmaske | Box + Klasse + Pixelmaske |

| Räumliche Präzision | Niedrig (RoI Pooling) | Höher (RoIAlign) | Höchste (Bilineare Interpolation) |

| Erkennungsgenauigkeit | ~38,0 AP (COCO) | ~38,8 AP (COCO) | 93,40 % (Schadensdatensatz) |

| Inferenzgeschwindigkeit | ~22,2 FPS | ~19,6 FPS | ~4,64 FPS |

| Segmentierungsqualität | Nicht verfügbar | Hoch | Sehr hoch (91,45 % Genauigkeit) |

| Anwendungsfall KFZ | Grobe Schadenslokalisation | Präzise Flächenmessung | Kostenberechnung durch exakte Schadensform |

Vorteile und Herausforderungen von Mask R-CNN in der KFZ-Branche

Mask R-CNN hat das Potenzial, die KFZ-Branche durch pixelgenaue Schadenserkennung zu revolutionieren. Im Vergleich zu einfachen Bounding Boxes bietet diese Technologie eine präzisere Analyse, indem sie Schäden direkt auf Pixelebene identifiziert. Das ermöglicht Versicherungen und Gutachtern, Reparaturkosten automatisiert zu berechnen. Hierbei wird das Verhältnis der Schadensmaske zur Gesamtfläche des betroffenen Bauteils genutzt. Beeindruckend ist auch, dass Mask R-CNN in einem einzigen Durchlauf verschiedene Schadenstypen wie Kratzer, Dellen oder Glasbrüche erkennen kann.

Ein weiterer Vorteil liegt in der Automatisierung digitaler Schadensprozesse. Diese optimieren den gesamten Ablauf erheblich, da eine erste Bewertung sofort und ohne manuelle Begutachtung erfolgen kann. Dank Transfer Learning können vortrainierte Modelle auch mit kleineren Datensätzen angepasst werden, was die Integration in bestehende Workflows erleichtert. Diese Erkenntnisse werden beispielsweise in den digitalen Prozessen von CUBEE genutzt.

Herausforderungen

Trotz der vielen Vorteile gibt es auch einige Hürden. Die Datenannotation ist besonders anspruchsvoll, da sie präzise Polygon-Markierungen erfordert. Das macht den Prozess zeit- und arbeitsintensiv. Ein weiteres Problem ist die benötigte Rechenleistung: Das Training der Modelle kann mehrere Tage dauern und erfordert leistungsstarke GPU-Hardware. Zudem leidet die Erkennungsgenauigkeit bei geringem Kontrast zwischen Fahrzeugfarbe und Schaden, da die Gradienten während des Trainings schwächer ausfallen.

Vor- und Nachteile im Überblick

Die folgende Tabelle fasst die wesentlichen Stärken und Schwächen von Mask R-CNN zusammen:

| Vorteil | Beschreibung | Herausforderung | Beschreibung |

|---|---|---|---|

| Hohe Präzision | Schäden wie Kratzer und Dellen werden pixelgenau lokalisiert | Datenanforderungen | Erfordert eine große Anzahl polygon-annotierter Bilder |

| Automatisierung | Beschleunigt Versicherungsprozesse und Gutachten-Workflows | Rechenaufwand | Lange Trainingszeiten und Bedarf an leistungsstarker GPU-Hardware |

| Mehrskalige Erkennung | Erkennt sowohl kleine Kratzer als auch große Dellen | Technische Komplexität | Probleme bei kontrastarmen Schäden oder unbekannten Szenarien |

| Vielseitigkeit | Anpassbar auf verschiedene Schadenstypen wie Glasbrüche oder Verschiebungen | Numerische Instabilitäten | Overflow-Probleme in bestimmten Backbone-Architekturen wie ResNet50 |

Ein erwähnenswerter Punkt ist die Inferenzgeschwindigkeit: Mit etwa 19,6 FPS liegt Mask R-CNN hinter Faster R-CNN (22,2 FPS). Dennoch liefert es die für präzise Schadensgutachten erforderliche Segmentierungsqualität. Um diese Herausforderungen zu meistern, sind gezielte Optimierungen notwendig, die in den kommenden Abschnitten näher erläutert werden.

Fazit und zentrale Erkenntnisse

Mask R-CNN bietet eine pixelgenaue Segmentierung von Schäden und ermöglicht eine automatisierte Kostenkalkulation, indem das Verhältnis der Schadensmaske zur Gesamtbildgröße berechnet wird. Versicherungsunternehmen profitieren von schnelleren Schadensabwicklungen durch KI-gestützte Erstbewertungen, während Kreditgeber die Technologie zur Bewertung von Gebrauchtwagen einsetzen. Die CUBEE Sachverständigen AG integriert Mask R-CNN in ihre digitalen Gutachten-Workflows, wodurch Begutachtungszeiten verkürzt und die Präzision durch KI-gestützte Plausibilitätsprüfungen gesteigert werden.

"Automation is the next step in the automobile industry, and a software which is able to detect and localize damage in the car has various real world applications." – Eashan Kaushik

Durch den Einsatz von Transfer Learning und vortrainierten Modellen können Herausforderungen wie aufwendige Datenannotation und hoher Rechenaufwand reduziert werden. Forscher haben bereits eine Genauigkeit von 89,5 % bei der Schadensklassifizierung erreicht, indem sie Transfer Learning mit Ensemble-Methoden kombiniert haben. Diese Fortschritte ebnen den Weg für eine weitergehende Automatisierung in der KFZ-Schadensbewertung.

Zukunftsperspektiven für Mask R-CNN in der KFZ-Schadensbewertung

Mask R-CNN markiert einen bedeutenden Fortschritt in der Objekterkennung, indem es von einfachen Bounding Boxes zu präzisen Pixel-Lokalisierungen übergeht. Experten sehen großes Potenzial in dieser Technologie:

"Picture based vehicle protection handling is a significant region with enormous degree for mechanization." – Sarath P

Die Optimierung polygon-basierter Annotationen verbessert die Detailgenauigkeit bei der Schadenserkennung. Zudem wird die Integration in Finanz-Workflows, wie etwa bei der Kreditvergabe für Gebrauchtwagen, weiter zunehmen. Bei der CUBEE Sachverständigen AG fließen diese Fortschritte direkt in die Erstellung schneller und präziser digitaler Gutachten ein. Durch kontinuierliche Verbesserungen der Modellarchitekturen und den Einsatz von Image Augmentation zur Vermeidung von Overfitting wird Mask R-CNN seine Rolle als Schlüsseltechnologie für digitale Schadensbewertungen weiter stärken.

FAQs

Wie viele Bilder benötigt man für ein effektives Mask R-CNN?

Für ein leistungsfähiges Mask R-CNN-Modell benötigt man in der Regel eine größere Anzahl von Bildern. Wie viele genau erforderlich sind, hängt stark von der Komplexität der Aufgabe und der Qualität der verfügbaren Daten ab. Oft wird jedoch empfohlen, mindestens mehrere Hundert bis Tausend Bilder zu verwenden, um verlässliche und präzise Ergebnisse zu erzielen.

Wie werden aus der Schadensmaske konkrete Reparaturkosten berechnet?

Die Reparaturkosten werden mithilfe der Schadensmaske geschätzt, wobei Faktoren wie Schadensart, -größe und notwendige Maßnahmen berücksichtigt werden. Die Software erstellt dabei eine erste Kostenschätzung, die anschließend durch eine fachkundige Begutachtung überprüft und bestätigt werden sollte. So wird eine genaue und effiziente Bewertung gewährleistet.

Welche Foto-Qualität ist nötig, damit die KI Schäden zuverlässig erkennt?

Hochwertige Fotos sind entscheidend, wenn es um eine präzise Schadensbewertung durch KI geht. Stellen Sie sicher, dass die Bilder klar und scharf sind, mit guter Beleuchtung aufgenommen werden und keine Bewegungsunschärfe enthalten. Nur so kann die KI die notwendigen Details erkennen und verlässliche Ergebnisse liefern.